הסטארט-אפ Lumia Security מגייס 18 מיליון דולר. הפלטפורמה של לומיה מגנה על ארגונים מפני סיכונים וחולשות הנוצרים בעקבות שימוש בלתי מבוקר של עובדים בכלים ובסוכני AI, ומאפשרת אימוץ בטוח של הטכנולוגיה, בהיקף רחב ובהתאם למדיניות האבטחה

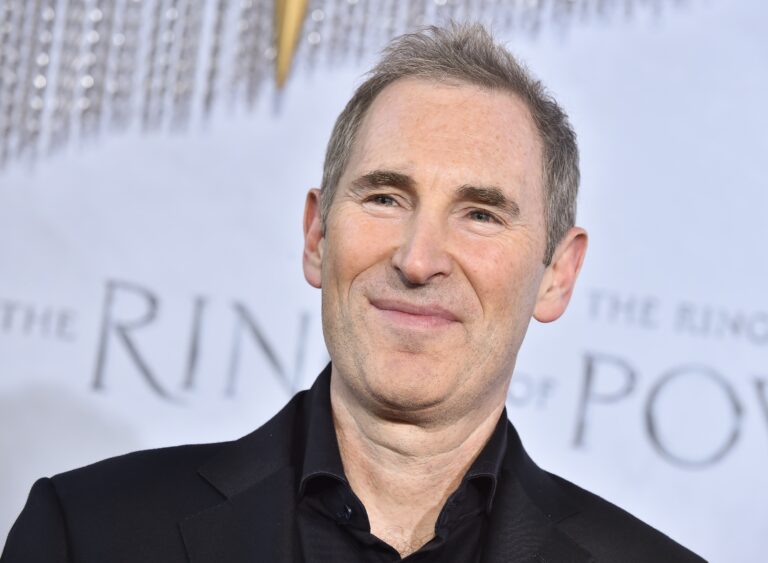

החברה הוקמה ע"י עומרי אילוז ממייסדי PerimeterX ואל"מ (במיל') בובי גילבורד בכיר לשעבר במערך הסייבר ב-8200. האדמירל מייק רוג'רס, לשעבר ראש ה-NSA וכיום שותף ב-Team8, מכהן כיו"ר הוועדה המייעצת.

החברה הוקמה כחלק ממודל ה-Venture Creation של Team8, שהובילה את סבב הגיוס בהשתתפות New Era. ההשקעה תאפשר את הרחבת ההון האנושי בדגש על צוותי ה-R&D, האצת פיתוח המוצר והגדלת פעילות החברה בשווקים הבינ"ל ע"י הרחבת פעילות השיווק והמכירות. הפלטפורמה כבר נמצאת בשימוש על ידי מוסדות פיננסיים וארגוני תעשייה וטכנולוגיה המנהלים מידע רגיש.

ללומיה משרדים בניו יורק ובישראל, בהם מועסקים 20 עובדי פיתוח ומחקר, והחברה מתכננת להגדיל את הצוותים ב-2026.

לפי דוח חדש של Team8 שנערך בשיתוף Ciso’s מחברות Fortune500 עלה כי סוכני AI הופכים למרכיב מרכזי בתשתיות הארגוניות – כ- 70% מהארגונים משתמשים ב-AI Agents בפרודקשן, 23% מתכננים להכניסם עד 2026, ו-67% מהארגונים מפתחים סוכנים פנימיים בעצמם. עם זאת, למרות שאימוץ AI נמצא בעלייה חדה (97% מהחברות), כמחצית מהחברות מגבילות את השימוש בכלים הפנימיים בשל סיכוני אבטחה והיעדר רגולציה. בין האתגרים המרכזיים של ה-Ciso’s: הגנת סוכני בינה מלאכותית (37%) וניהול שימוש העובדים (36%).

הבעיה העיקרית נובעת מכך שאין בידי צוות הבקרה את הכלים לנטר אחר המשתמשים והאייג'נטים, לבחון מה הסיכונים והחשיפה לארגון כתוצאה מאינטראקציות, מה כל סוכן מבצע בפועל, תחת אילו הרשאות ומה ההשלכות העסקיות. כתוצאה מכך נוצרים פערי אבטחה ללא מטופלים, לצד גישות ופעילויות לא מבוקרות במערכות הארגון. כל אלו מובילים חלק מהארגונים להגביל או לחסום שימוש ב-AI גם על חשבון פגיעה בתפוקה.

המוצר של Lumia Security מנטר ומפקח על השימוש ב-AI לאורך כלל שרשרת הארגון, הן מצד עובדים והן מצד סוכנים אוטונומיים, מה שמעניק נראות ושליטה מלאה בכל אינטראקציה בזמן אמת, בהתאם למדיניות רגולציה וסטנדרט אבטחת המידע של הארגון. הפלטפורמה מנתחת כל אינטראקציה של משתמש מול AI ואת כלל פעולות סוכני ה-AI בארגון, ומבצעת הערכת סיכונים מתוך התוכן, הקונטקסט וכוונת המשתמש. כך מתבצעת אכיפה מדויקת וחכמה, מבלי שצוותי האבטחה יצטרכו לחסום שירותים או לנסות להקשיח כל כלי בנפרד.

בתהליך הטמעה פשוט וללא שינוי בתשתיות קיימות, המוצר של לומיה מאפשר לארגונים להרחיב את אימוץ ה-AI ברמה התשתיתית והארגונית בצורה מבוקרת ומאובטחת, ללא חשש לפגיעה בביזנס, תהליכי העבודה וחוויית המשתמש.

עמרי אילוז, מייסד-שותף ומנכ"ל Lumia Security: "בעידן שבו הבינה המלאכותית משנה את כללי המשחק, מנהלי אבטחת מידע נתונים ללחץ הולך וגובר. מחד, הם אינם יכולים לחסום שימוש בכלים שמייצרים קפיצה דרמטית בתפוקה ובפרודוקטיביות, ומאידך אינם יכולים להתעלם מהסיכונים הנוצרים משימוש לא מאובטח.

"הפלטפורמה שפיתחנו מאפשרת לארגונים לאמץ בינה מלאכותית בצורה מאובטחת ואחראית תוך ניהול בקרה רציפה בסקייל רחב, כך שהטכנולוגיה משרתת את הארגון ולא פותחת פתח לסיכונים מיותרים".

מייק רוג'רס, יו"ר הוועדה המייעצת ב-Lumia, שותף ב-Team8, לשעבר ראש ה-NSA: "עידן ה-AI מתקדם מהר יותר ממה שרוב הארגונים ערוכים אליו. הפער הזה מדגיש את הצורך הקריטי במנגנוני בקרה, שיאפשרו לארגונים גלובליים לשלוט באופן מלא ודינמי בכל פעולת AI ברמה הפנימית – לפני עיגון מערכות AI באופן מלא בכל תהליכי העבודה בארגונים".